-

1 мера количества информации

мера количества информации

—

[Л.Г.Суменко. Англо-русский словарь по информационным технологиям. М.: ГП ЦНИИС, 2003.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > мера количества информации

-

2 мера (количества) информации

Information technology: information measureУниверсальный русско-английский словарь > мера (количества) информации

-

3 мера количества информации

Information technology: information measureУниверсальный русско-английский словарь > мера количества информации

-

4 мера информации

1) Engineering: information measure (количества)2) Information technology: (количества) information measure -

5 мера информации

nIT. (количества) mesure d'information -

6 количество взаимной информации в случайных величинах

количество взаимной информации в случайных величинах

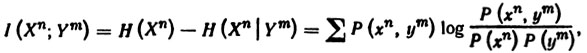

Мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усредненного по знаниям последней; для дискретных случайных величин ее выражение имеет вид

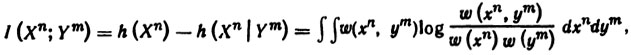

где суммирование ведется по всему множеству значений хn, уm случайных величин Xn, ym; для непрерывных случайных величин ее выражение имеет вид

где интегрирование ведется по всему множеству значений xn, уm случайных величин Хn, Уm.

Примечания

1. Вместо термина «количество взаимной информации в случайных величинах» иногда употребляют выражение «количество информации о случайной величине, содержащееся в другой случайной величине».

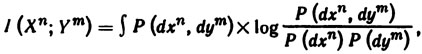

2. Общая форма математической записи выражения количества взаимной информации, справедливая в произвольном случае, имеет вид

где Р(хn, уm), Р(хn) и Р(уm) —вероятностные меры, заданные соответственно на множествах значений {хn, уm), хn и уm случайных величии (Xn, Уm), Хn и Уm.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > количество взаимной информации в случайных величинах

-

7 хартли

1) Information technology: hartley (мера количества информации), hartly (единица количества информации)2) Makarov: the hartley -

8 хартли

-

9 хартли

( логарифмическая мера количества информации) hartleyРусско-английский словарь по вычислительной технике и программированию > хартли

-

10 хартли

-

11 хартли

-

12 хартли

хартли

Логарифмическая мера измерения количества информации в двоичных единицах, равная log2n, где n - объем информации, выраженный в битах. Названа по имени американского ученого R.V. Hartley, предложившего эту меру в 1928 г.

[Л.М. Невдяев. Телекоммуникационные технологии. Англо-русский толковый словарь-справочник. Под редакцией Ю.М. Горностаева. Москва, 2002]Тематики

- электросвязь, основные понятия

EN

Русско-английский словарь нормативно-технической терминологии > хартли

-

13 информация (в кибернетике)

информация (в кибернетике)

Основное понятие кибернетики, точно так же экономическая И. — основное понятие экономической кибернетики. Определений этого термина много, они сложны и противоречивы. Причина этого, очевидно, в том, что И. как явлением занимается много разных наук, и кибернетика лишь самая молодая из них. И. — предмет изучения таких наук, как наука об управлении, математическая статистика, генетика, теория средств массовой И. (печать, радио, телевидение), информатика (1), занимающаяся проблемами научно-технической И., и т.д. Наконец, последнее время большой интерес к проблемам И. проявляют философы: они склонны рассматривать И. как одно из основных универсальных свойств материи, связанное с понятием отражения. При всех трактовках понятия И., она предполагает существование двух объектов: источника И. и потребителя (получателя) И. Передача И. от одного к другому происходит с помощью сигналов, которые, вообще говоря, могут не иметь никакой физической связи с ее смыслом: эта связь определяется соглашением. Например, удар в вечевой колокол означал, что надо собираться на площадь, но тем, кто не знал об этом порядке, он не сообщал никакой И. В ситуации с вечевым колоколом человек, участвующий в соглашении о смысле сигнала, знает, что в данный момент могут быть две альтернативы: вечевое собрание состоится или не состоится. Или, выражаясь языком теории И., неопределенное событие «вече» имеет два исхода. Принятый сигнал приводит к уменьшению неопределенности: человек теперь знает, что событие «вече» имеет только один исход — оно состоится. Однако, если было заранее известно, что вече состоится в таком-то часу, колокол ничего нового не сообщил. Отсюда вытекает, что, чем менее вероятно (т.е. более неожиданно) сообщение, тем больше И. оно содержит, и наоборот, чем больше вероятность исхода до совершения события, тем меньше И. содержит сигнал. Примерно такие рассуждения привели в 40-х годах XX в. к возникновению статистической, или «классической«, теории И., которая определяет понятие И. через меру уменьшения неопределенности знания о свершении какого-либо события (такая мера была названа энтропией). У истоков этой науки стояли Н.Винер, К.Шеннон и советские ученые А.Н.Колмогоров, В.А.Котельников и др. Им удалось вывести математические закономерности измерения количества И., а отсюда и такие понятия, как пропускная способность канала И., емкость запоминающих И. устройств и т.п., что послужило мощным стимулом к развитию кибернетики как науки и электронно-вычислительной техники, как применения достижений кибернетики на практике. Что касается определения ценности, полезности И. для получателя, то здесь еще много нерешенного, неясного. Если исходить из потребностей экономического управления и, следовательно, экономической кибернетики, то И. можно определить как все те сведения, знания, сообщения, которые помогают решить ту или иную задачу управления (т.е. уменьшить неопределенность ее исходов). Тогда открываются и некоторые возможности для оценки И.: она тем полезнее, ценнее, чем скорее или с меньшими затратами приводит к решению задачи. Понятие И. близко понятию «данные«. Однако между ними есть различие: данные — это сигналы, из которых еще надо извлечь И. Обработка данных есть процесс приведения их к пригодному для этого виду. Процесс их передачи от источника к потребителю и восприятия в качестве И. может рассматриваться как прохождение трех фильтров: 1) физического, или статистического (чисто количественное ограничение по пропускной способности канала, независимо от содержания данных, т.е. с точки зрения синтактики); 2) семантического (отбор тех данных, которые могут быть поняты получателем, т.е. соответствуют тезаурусу его знаний); 3) прагматического (отбор среди понятых сведений тех, которые полезны для решения данной задачи). Это хорошо показано на схеме, взятой из книги Е.Г.Ясина об экономической информации (см. рис. И.8). Соответственно, выделяются три аспекта изучения проблем И. — синтаксический, семантический и прагматический. По содержанию И. подразделяется на общественно-политическую, социально-экономическую (в том числе экономическую И.), научно-техническую и т.д. Вообще же классификаций И. много, они строятся по различным основаниям. Как правило, из-за близости понятий точно так же строятся и классификации данных. Например, И. подразделяется на статическую (постоянную) и динамическую (переменную), и данные при этом — на постоянные и на переменные. Другое деление — первичная, производная, выходная И.: так же классифицируются данные. Третье деление — И. управляющая и осведомляющая. Четвертое — избыточная, полезная и ложная. Пятое — полная (сплошная) и выборочная. См. также Банк данных, Данные, Выборочная информация, Избыточная информация, Обработка данных, Прагматический аспект информации, Релевантная информация, Сбор данных, Семантический аспект информации Теория информации, Экономическая информация, Экономическая семиотика, Энтропия. Рис. И 8. Процесс передачи и восприятия информации Д — данные; I — физический фильтр (канал связи), 1 — статистическая информация, а — статистический шум; II — семантический фильтр (тезаурус), 2 — семантическая информация, б - семантический шум; III — прагматический фильтр, 3 — прагматическая информация; в — прагматический шум (ненужная, например,. избыточная информация). И — используемая информация.

[ http://slovar-lopatnikov.ru/]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > информация (в кибернетике)

См. также в других словарях:

мера количества информации — — [Л.Г.Суменко. Англо русский словарь по информационным технологиям. М.: ГП ЦНИИС, 2003.] Тематики информационные технологии в целом EN information measure … Справочник технического переводчика

ИНФОРМАЦИИ ТЕОРИЯ — раздел математики, исследующий процессы хранения, преобразования и передачи информации. В основе его лежит определенный способ измерения количества информации. Возникшая из задач теории связи, теория информации иногда рассматривается как… … Энциклопедия Кольера

ТЕОРИЯ ИНФОРМАЦИИ — теория, изучающая законы и способы измерения, преобразования, передачи, использования и хранения информации. В Т. и. и ее технич. приложениях центральными являются понятия количества информации и его меры. Эти понятия в известной степени… … Философская энциклопедия

мера — 3.9 мера [измерения]2) (measure): Переменная, которой присваивается некоторое значение, полученное в результате измерения. 2) В контексте настоящего стандарта термин «measure» следует понимать как «мера измерения». [ИСО/МЭК 15939:2007] Примечание … Словарь-справочник терминов нормативно-технической документации

Мера (в метрологии) — В физике и технике единицы измерения (единицы физических величин, единицы величин[1]) используются для стандартизованного представления результатов измерений. Численное значение физической величины представляется как отношение измеренного… … Википедия

Энтропия (теория информации) — Энтропия (информационная) мера хаотичности информации, неопределённость появления какого либо символа первичного алфавита. При отсутствии информационных потерь численно равна количеству информации на символ передаваемого сообщения. Например, в… … Википедия

Избыточность информации — В этой статье не хватает ссылок на источники информации. Информация должна быть проверяема, иначе она может быть поставлена под сомнение и удалена. Вы можете … Википедия

МИ 2893-2004: Рекомендация. Государственная система обеспечения единства измерений. Системы измерений количества и показателей качества нефти. Испытания с целью утверждения типа. Общие положения и организация работ в системе магистрального нефтепроводного транспорта ОАО "АК "Транснефть" — Терминология МИ 2893 2004: Рекомендация. Государственная система обеспечения единства измерений. Системы измерений количества и показателей качества нефти. Испытания с целью утверждения типа. Общие положения и организация работ в системе… … Словарь-справочник терминов нормативно-технической документации

ГОСТ Р 50922-96: Защита информации. Основные термины и определения — Терминология ГОСТ Р 50922 96: Защита информации. Основные термины и определения оригинал документа: 2 Защита информации деятельность по предотвращению утечки защищаемой информации, несанкционированных и непреднамеренных воздействий на защищаемую… … Словарь-справочник терминов нормативно-технической документации

количество взаимной информации в случайных величинах — Мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усредненного по знаниям последней; для дискретных случайных величин ее выражение имеет вид где… … Справочник технического переводчика

ГОСТ ИСО 8601-2001: Система стандартов по информации, библиотечному и издательскому делу. Представление дат и времени. Общие требования — Терминология ГОСТ ИСО 8601 2001: Система стандартов по информации, библиотечному и издательскому делу. Представление дат и времени. Общие требования оригинал документа: 2.30 век (в григорианском календаре): Календарный год, номер которого кратен… … Словарь-справочник терминов нормативно-технической документации